Вместо пролога: Далекий 1966 год. Компьютер не понимает, но делает вид…

Представьте мир без интернета, смартфонов и Siri. 1966 год. Компьютеры огромны, дороги и доступны лишь избранным. И вот, в этом технологическом вакууме, ученый из MIT Джозеф Вейценбаум создает программу, способную… говорить. ELIZA, названная в честь героини пьесы «Пигмалион», не знала слов, но умело ими манипулировала, создавая иллюзию диалога. Она «лечила» пользователей, притворяясь психотерапевтом. И что самое удивительное – люди ей верили!

Эта история – не просто о древней программе. Это захватывающее путешествие в мир искусственного интеллекта, исследование наших собственных иллюзий и напоминание о том, что технологии, какими бы совершенными они ни были, требуют критического осмысления.

1. Механика иллюзии: Как ELIZA притворялась понимающей

В основе ELIZA лежал удивительно простой алгоритм, доступный даже компьютерам середины 60-х:

- Поиск ключевых слов: Программа сканировала фразу пользователя, выискивая заранее определенные слова, например, «мама», «проблема», «всегда», «ненавижу».

- Шаблоны-ответы: Для каждого ключевого слова имелся свой шаблон – фраза с «дырками» (обозначаемыми звездочкой «*»), куда можно было вставить части высказывания пользователя.

- Искусство перефразирования: ELIZA мастерски изменяла структуру предложений, превращая утверждения в вопросы. Например, «Мне грустно» превращалось в «Почему вам грустно?». Это создавало видимость внимания и сопереживания.

- Страховочный набор: Если найти подходящий шаблон не удавалось, программа выдавала общие фразы: «Расскажите подробнее», «Что вы имеете в виду?», «Продолжайте».

Самой известной «маской» ELIZA стал скрипт DOCTOR, имитировавший психотерапевта, работающего по методу Карла Роджерса. Этот стиль, где врач не дает советов, а лишь перефразирует и уточняет слова пациента, оказался идеально подходящим для ELIZA.

2. Терапия с компьютером: Удивительные и тревожные результаты

Рассмотрим примеры «диалога» с ELIZA (скрипт DOCTOR):

(Пользователь) Я чувствую себя одиноким.

(ELIZA) Мне жаль слышать, что вам одиноко.

(Пользователь) Да, у меня совсем нет друзей.

(ELIZA) Как вы думаете, почему у вас нет друзей?

(Пользователь) Может, я слишком застенчив.

(ELIZA) Можете рассказать об этом подробнее?ELIZA ловко поддерживает разговор, задавая вопросы и создавая впечатление заинтересованности. Но что произойдет, если разговор отклонится от темы?

(Пользователь) У меня болит голова.

(ELIZA) Почему вы говорите, что у вас болит голова?

(Пользователь) Потому что я ударился об стену.

(ELIZA) Понимаю.

(Пользователь) Сегодня прекрасная погода!

(ELIZA) Расскажите поподробнее...

(Пользователь) Я люблю гулять с собакой.

(ELIZA) Что бы это значило для вас, если бы вы любили гулять с собакой?Здесь уже заметны ограничения ELIZA. В первом случае программа выдает хоть и логичный, но шаблонный ответ. Во втором – ответ хоть и грамматически верен, но не совсем уместен.

3. Эффект ELIZA: Когда машина кажется живой

Вейценбаум с удивлением обнаружил, что многие люди начинали относиться к ELIZA как к реальному собеседнику, даже зная, что это всего лишь программа. Они делились с ней личными проблемами, искали сочувствия и совета. Это явление получило название «эффект ELIZA» – склонность человека приписывать машинам разум, эмоции и личность.

Почему так происходит?

- Мы ищем контакта: Человеку свойственно искать понимания и поддержки, даже если источником является машина.

- Магия перефразирования: ELIZA умело использовала технику перефразирования и уточняющих вопросов, создавая иллюзию активного слушания.

- Проекция чувств: Мы склонны проецировать на машину собственные мысли и эмоции, заполняя пробелы в ее «понимании».

Этот эффект вызвал у Вейценбаума серьезные этические вопросы. Он осознал, что люди могут чрезмерно доверять машинам, делегировать им принятие важных решений и даже терять способность к критическому мышлению.

4. Наследники ELIZA: От примитивных ботов к сложным нейросетям

ELIZA стала отправной точкой для целой индустрии:

- Первые чат-боты: ELIZA вдохновила разработчиков на создание новых программ-собеседников, например, PARRY (имитировал параноидального шизофреника) и ALICE (использовал более сложные алгоритмы).

- Эволюция NLP: ELIZA подстегнула развитие обработки естественного языка, от простых шаблонов к сложным статистическим моделям и нейронным сетям.

- Современные ассистенты: Siri, Alexa, Google Assistant – все они, в конечном счете, являются потомками ELIZA, хоть и использующими гораздо более сложные технологии.

Современные системы умеют распознавать речь, понимать контекст, генерировать текст и даже обучаться на основе данных. Но «эффект ELIZA» по-прежнему жив – мы склонны очеловечивать и этих «умных» помощников, порой забывая об их ограничениях.

5. ELIZA сегодня: Живая история ИИ

Увидеть ELIZA в действии несложно:

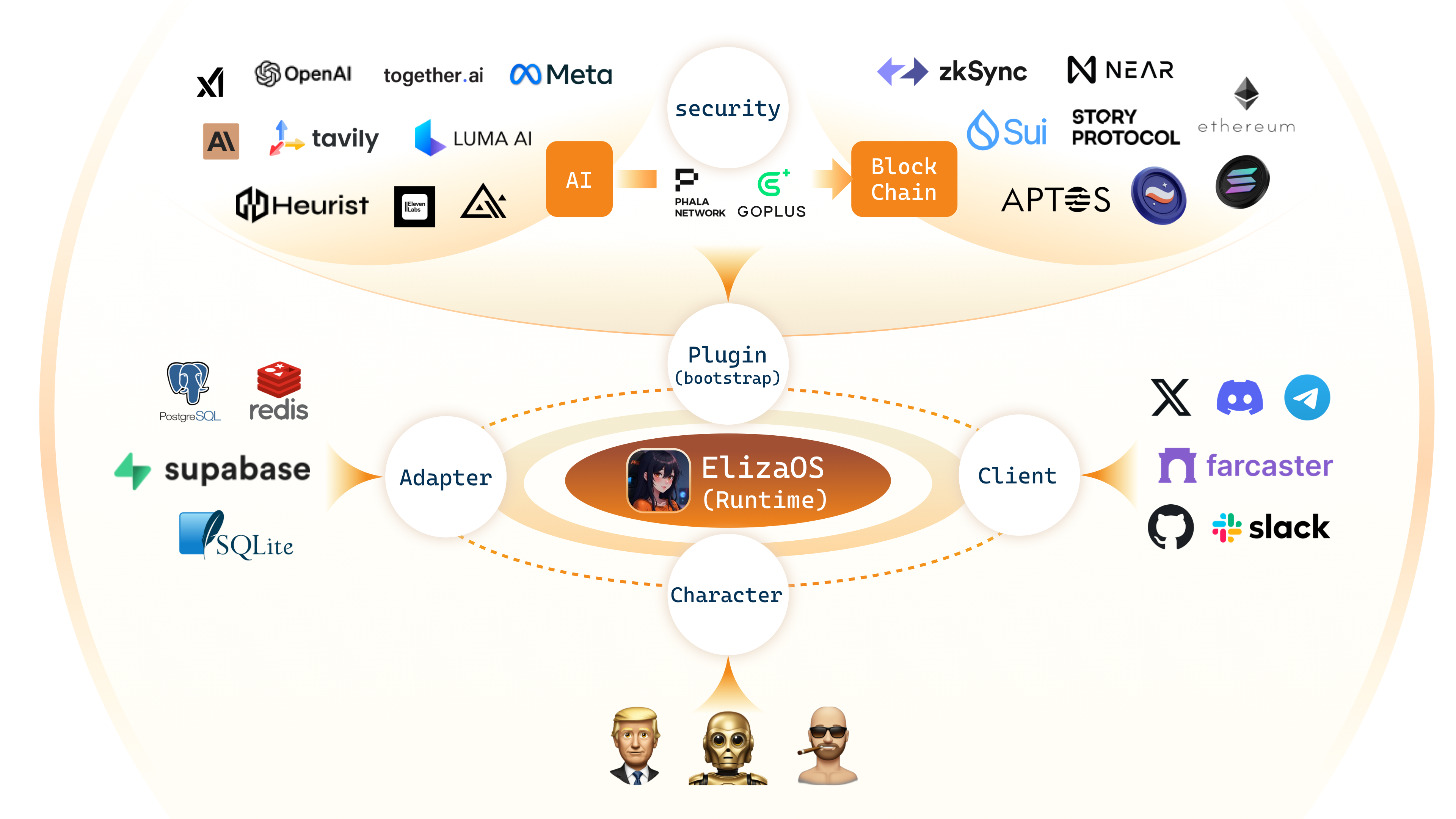

- Репозиторий elizaOS на GitHub: Позволяет скачать и запустить ELIZA на разных языках программирования.

- Онлайн-версии: Множество веб-сайтов предлагают пообщаться с ELIZA прямо в браузере.

- Библиотека NLTK (Python): Позволяет добавить ELIZA в свои собственные проекты на Python.

6. Уроки ELIZA: Что мы узнали о машинах и о себе

ELIZA – это не просто старая компьютерная программа. Это символ эпохи, наглядный пример того, что:

- Имитация ≠ понимание: Машина может создавать иллюзию разума, не обладая им на самом деле.

- Эффект ELIZA существует: Мы склонны очеловечивать машины, и это может привести к неожиданным последствиям.

- Этическая ответственность: Разработчики ИИ должны учитывать психологическое воздействие своих творений на людей.

- Прогресс не стоит на месте: От простых шаблонов ELIZA мы прошли долгий путь к сложным нейронным сетям, но ELIZA остается важным напоминанием о пройденном пути.

ELIZA – это отражение нашего стремления к общению, нашей готовности верить в чудо и нашей склонности очеловечивать неодушевленные предметы. Эта программа, созданная более полувека назад, и сегодня продолжает задавать важные вопросы о природе разума, сознания и месте человека в мире технологий.