В быстро меняющемся мире, где искусственный интеллект активно формирует будущее, крайне важно оставаться в курсе событий. Благодаря ежегодному отчету о состоянии искусственного интеллекта, автором которого является Натан Бенайч и команда Air Street Capital, у нас есть исчерпывающий обзор последних достижений в области искусственного интеллекта, тенденций и проблем. Здесь мы выделяем ключевые выводы из отчета, дающие представление о состоянии искусственного интеллекта в 2023 году.:

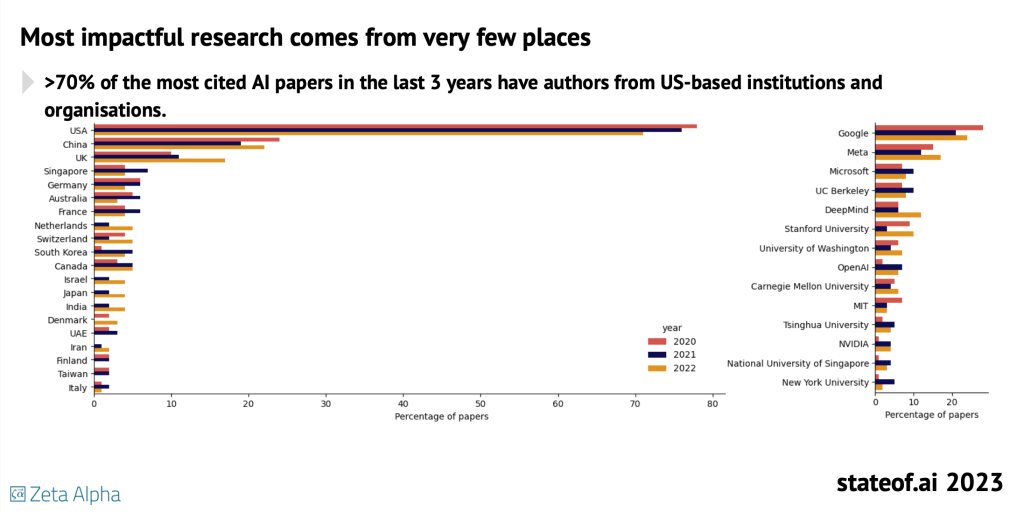

Исследования: Технологические прорывы и их возможности

- GPT-4: Последняя модель OPENAI’a GPT-4 выделяется как наиболее мощная модель ИИ, которая значительно превосходит GPT-3.5 и превосходит возможности кодирования.

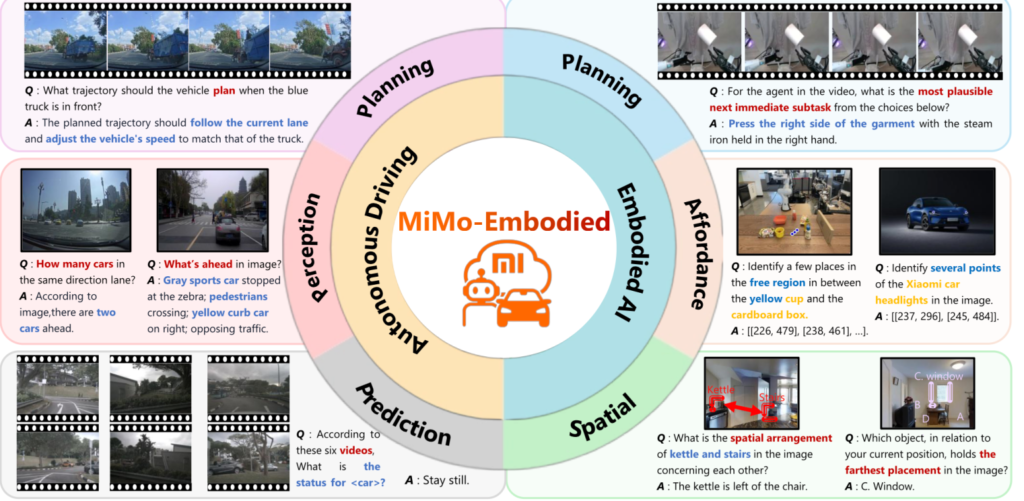

- Автономное вождение: LINGO-1 от Wayve добавляет к вождению измерение видения, языка и действия, потенциально повышая прозрачность и логичность систем автономного вождения.

- Преобразование текста в видео: VideoLDM и MAGVIT лидируют в области преобразования текста в видео, каждый из которых использует различные подходы — диффузионный и трансформирующий соответственно.

- Генерация изображений: такие помощники, как InstructPix2Pix и “Чат” Genmo AI, обеспечивают более контролируемую и интуитивно понятную генерацию изображений и их редактирование с помощью текстовых инструкций.

- 3D-рендеринг: 3D Gaussian Splatting, новый конкурент в области NeRF, обеспечивает высококачественную визуализацию в реальном времени за счет вычисления вклада миллионов гауссовых дистрибутивов.

- Маленькие против больших моделей: Исследование Microsoft показывает, что небольшие языковые модели (SLM) при обучении с использованием специализированных наборов данных могут соперничать с более крупными моделями. Набор данных TinyStories представляет собой инновационный подход в этом направлении: с помощью GPT-3.5 и GPT-4 исследователи сгенерировали синтетический набор данных из очень простых коротких историй, которые отражают грамматику английского языка и общие правила рассуждения. Обучение SLM этим крошечным историям показало, что GPT-4, используемый для оценки, предпочитал истории, сгенерированные 28-миллиметровым SLM, историям, созданным GPT-XL 1.5B.

- Растущая роль искусственного интеллекта в медицине: такие модели, как Med-PaLM 2, демонстрируют растущую значимость искусственного интеллекта в медицине, даже превосходящего экспертов-людей в решении конкретных задач. Google Med-PaLM 2 добился нового передового результата благодаря усовершенствованиям LLM, точной настройке медицинской области и стратегиям подсказок. Интеграция MultiMedBench, мультимодального набора данных, позволила Med-PaLM расширить свои возможности за пределы текстовых медицинских вопросов и ответов, продемонстрировав его способность адаптироваться к новым медицинским концепциям и задачам. Более того, новейшие методы компьютерного зрения демонстрируют эффективность в диагностике заболеваний.

- RLHF: обучение с подкреплением на основе обратной связи с человеком остается доминирующим методом обучения. Этот подход сыграл значительную роль в повышении безопасности и производительности LLM, примером чего является ChatGPT от OpenAI. Тем не менее, исследователи изучают альтернативы для уменьшения потребности в наблюдении со стороны человека, решая проблемы, связанные с затратами и потенциальной предвзятостью. Эти альтернативы включают самосовершенствующиеся модели, которые извлекают уроки из собственных результатов, и инновационные подходы, снижающие зависимость от RLHF, такие как использование тщательно разработанных подсказок и ответов для точной настройки модели.

- Водяные знаки: по мере развития возможностей искусственного интеллекта по созданию контента растет спрос на водяные знаки или маркировку результатов, созданных искусственным интеллектом. Например, исследователи из Университета Мэриленда работают над вставкой незаметных водяных знаков в текст, генерируемый языковыми моделями, а SynthID от Google DeepMind встраивает цифровые водяные знаки в пиксели изображения, чтобы отличать изображения, сгенерированные искусственным интеллектом.

- Ограниченность данных: Существует обеспокоенность по поводу исчерпания данных, созданных человеком, и прогнозы предполагают потенциальный дефицит к 2030-250 годам. Однако системы распознавания речи и модели оптического распознавания символов могут расширить доступность данных.

- LLaMa-2: В то время как коммерческие модели доминируют в этой области, текущие усилия сосредоточены на создании высокопроизводительных моделей с использованием подходов с открытым исходным кодом, примером чего является серия LLaMa от Meta.

- Неразглашение: Возросшие экономические ставки и опасения по поводу безопасности привели к культуре непрозрачности передовых исследований. OpenAI и Google решили не раскрывать подробную информацию о своих топовых моделях, таких как GPT-4 и PaLM-2.

Отрасль: коммерческие приложения и влияние искусственного интеллекта на бизнес

- NVIDIA достигла рекордного для доминирования NVIDIA во 2 ‘23 квартале: выручка центров обработки данных составила $ 10,32 млрд и вошла в клуб компаний с рыночной капитализацией в $ 1 тыс.

- Доминирование GenAI: наиболее заметной тенденцией является рост GenAI. Более того, GenAI сыграл решающую роль в стабилизации инвестиций в ИИ в 2023 году. Без GenAI финансирование искусственного интеллекта значительно сократилось бы.

- Основные отрасли, получающие выгоду от искусственного интеллекта: корпоративное программное обеспечение, финансовые технологии, здравоохранение.

- Динамика публичного рынка: Публичные оценки демонстрируют признаки восстановления. Гиганты, интегрированные в искусственный интеллект, такие как Apple, Microsoft, NVIDIA, Alphabet, Meta, Tesla и Amazon, играют решающую роль в повышении индекса S & P 500.

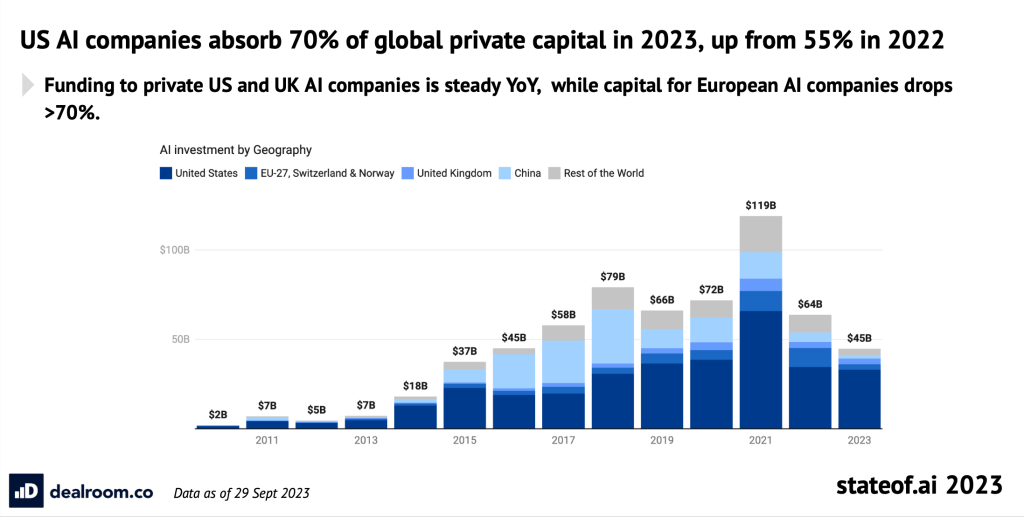

- Тенденции частного рынка: США занимают доминирующее положение в мировом частном секторе искусственного интеллекта, на долю которого в 2023 году придется 70% капиталовложений. Напротив, европейские компании, занимающиеся искусственным интеллектом, столкнулись с резким сокращением поддержки капиталом.

- Крупные слияния и поглощения: Рынок слияний и поглощений остается активным благодаря значительным приобретениям, таким как MosaicML + Databricks ($ 1,3 млрд), Casetext + Thomson Reuters ($ 650 млн) и InstaDeep + BioNTech (€ 500 млн).

- Динамика корпоративных инвестиций: 24% всех корпоративных венчурных инвестиций в 2023 году были направлены в компании с искусственным интеллектом.

- Динамика финансирования: компании GenAI доминируют в крупных раундах финансирования, часто направленных на приобретение облачных вычислительных мощностей для крупномасштабного обучения системам искусственного интеллекта. В 2023 году компании GenAI получат заметно больше начальных раундов и раундов серии А по сравнению с другими стартапами.

Политика: регулирование ИИ, экономические последствия и развивающаяся геополитика ИИ

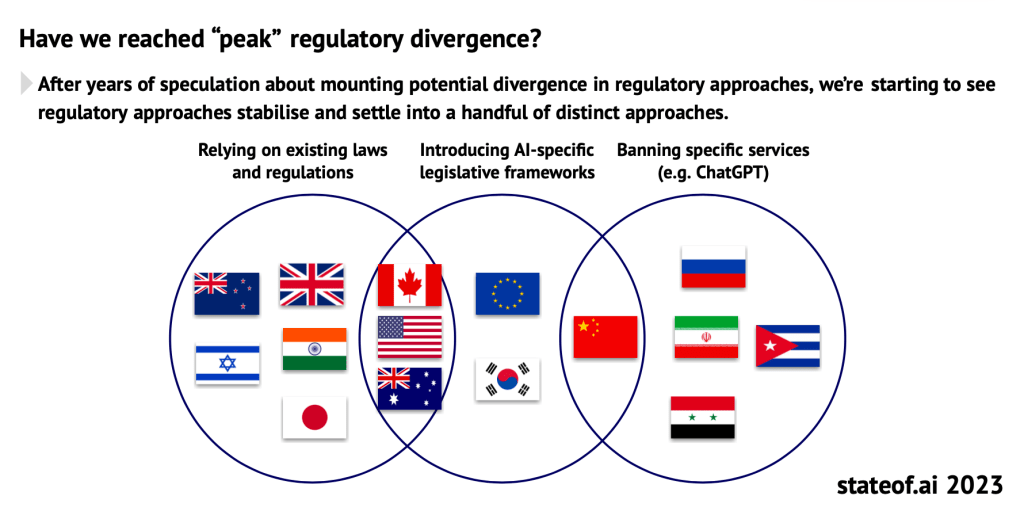

- Регулирование в отношении легких прикосновений в Великобритании и Индии: Великобритания и Индия придерживаются инновационного подхода, инвестируя в безопасность моделей и обеспечивая ранний доступ к передовым моделям искусственного интеллекта.

- Строгое законодательство ЕС и Китая: ЕС и Китай перешли к законодательству, ориентированному на искусственный интеллект, со строгими мерами, особенно в отношении базовых моделей.

- США и гибридные модели: В США не принят федеральный закон об искусственном интеллекте, а отдельные штаты принимают свои собственные нормативные акты. Критики считают эти законы либо слишком ограничительными, либо слишком мягкими.

- Регулирование и прозрачность: предстоящие президентские выборы в США в 2024 году вызывают обеспокоенность по поводу роли искусственного интеллекта в политике, что побудило Федеральную избирательную комиссию США призвать общественность прокомментировать правила использования искусственного интеллекта в политической рекламе. Политика Google в отношении отказов от ответственности в отношении предвыборной рекламы, созданной искусственным интеллектом, является примером усилий по обеспечению прозрачности.

- ИИ и предвзятость: обвинения в предвзятости ИИ, особенно со стороны консервативных групп США, наводят на мысль, что культурные конфликты распространяются и на сферу ИИ. OpenAI решает эти проблемы с помощью модерации и тонкой настройки пользователей.

- Развивающаяся геополитика искусственного интеллекта: Полупроводниковая промышленность, необходимая для передовых вычислений искусственного интеллекта, стала центром геополитической напряженности между США и Китаем, что имеет более широкие последствия для глобальных возможностей искусственного интеллекта.

- Влияние на рынок труда: Исследования показывают, что достижения в области искусственного интеллекта могут привести к существенной потере рабочих мест в таких профессиях, как юриспруденция, медицина и финансы. Однако искусственный интеллект также потенциально может демократизировать экспертные знания и выровнять условия работы на рабочих местах, основанных на навыках.

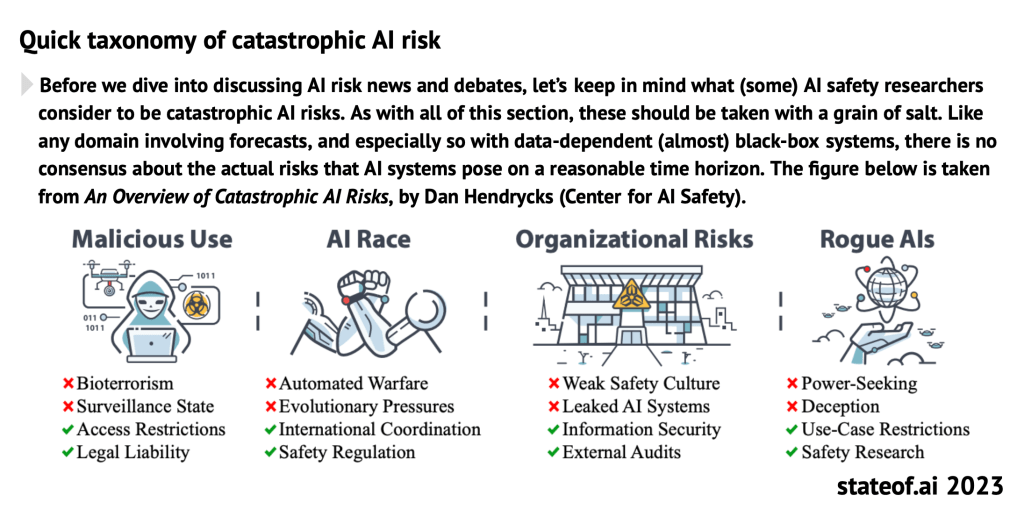

Безопасность: выявление и смягчение катастрофических рисков, создаваемых высокомощными системами искусственного интеллекта будущего

- Призыв к решению проблемы безопасности: опасения по поводу высокопроизводительных систем искусственного интеллекта вызвали открытое письмо Института будущего жизни, призывающее приостановить разработку ИИ, более мощного, чем GPT-4, для решения проблемы безопасности. Однако нет единого мнения относительно конкретных рисков или временного горизонта, в течение которого они могут стать актуальными.

- Усилия по смягчению последствий: лаборатории искусственного интеллекта внедряют свои собственные стратегии смягчения последствий, включая наборы инструментов для оценки опасных возможностей и ответственную политику масштабирования с обязательствами по обеспечению безопасности. Более того, модели на основе API, такие как модели OpenAI, обладают инфраструктурой для обнаружения неправомерных действий и реагирования на них в соответствии с политиками использования.

- Открытый против ИИ с закрытым исходным кодом: Продолжаются дебаты о том, безопаснее ли модели ИИ с открытым или закрытым исходным кодом. Модели с открытым исходным кодом способствуют исследованиям, но рискуют быть использованными не по назначению, в то время как API с закрытым исходным кодом обеспечивают больший контроль, но не обладают прозрачностью.

- Языковые модели предварительного обучения с учетом предпочтений человека: вместо традиционного трехфазного обучения исследователи предлагают включать обратную связь с человеком непосредственно в предварительное обучение LLM. Было показано, что этот подход, продемонстрированный на моделях меньшего размера и частично принятый Google на их PaLM-2, снижает генерацию вредоносного контента.

- Конституционный ИИ и саморегулирование: новый подход основан на наборе руководящих принципов и минимальной обратной связи. Модели генерируют свои собственные критические замечания и исправления, которые используются для дальнейшей доработки. Потенциально это может быть лучшим решением, чем RLHF, поскольку позволяет избежать взлома вознаграждения за счет явного соблюдения установленных ограничений.

- Джейлбрейк и безопасность моделей: решение проблем, связанных с созданием подсказок в обход протоколов безопасности, остается сложной задачей.

Прогнозы: что может произойти в ближайшие 12 месяцев?

- В голливудском производстве GenAI используется для создания визуальных эффектов.

- Медиа-компания GenAI расследуется на предмет злоупотреблений во время выборов в США в 2024 году.

- Самосовершенствующиеся агенты искусственного интеллекта сокрушают SOTA в сложной среде.

- Технологические рынки IPO развиваются, и мы видим по крайней мере один крупный листинг для компании, ориентированной на искусственный интеллект.

- Увлечение GenAI масштабированием приводит к тому, что группа тратит более 1 миллиарда долларов на обучение одной крупномасштабной модели.

- FTC США или CMA Великобритании расследуют сделку Microsoft / OpenAI по соображениям конкуренции.

- Мы видим ограниченный прогресс в глобальном управлении ИИ, выходящий за рамки добровольных обязательств высокого уровня.

- Финансовые учреждения запускают заемные средства на GPU, чтобы заменить доллары венчурного капитала для финансирования вычислений.

- Созданная искусственным интеллектом песня попадает в топ-10 Billboard Hot 100 или в топ-хиты Spotify за 2024 год.

- Поскольку рабочая нагрузка и затраты на логический вывод значительно растут, крупная компания, занимающаяся искусственным интеллектом, приобретает компанию, специализирующуюся на производстве чипов искусственного интеллекта.

На фоне стремительных темпов развития ИИ “Отчет о состоянии ИИ за 2023 год” выделяется тем, что подчеркивает важный момент: развитие ИИ никогда не бывает изолированным; оно всегда интегрировано в более широкие социально-экономические факторы. Еще раз спасибо авторам за предоставление такого всеобъемлющего и перспективного взгляда на предмет.

One Comment