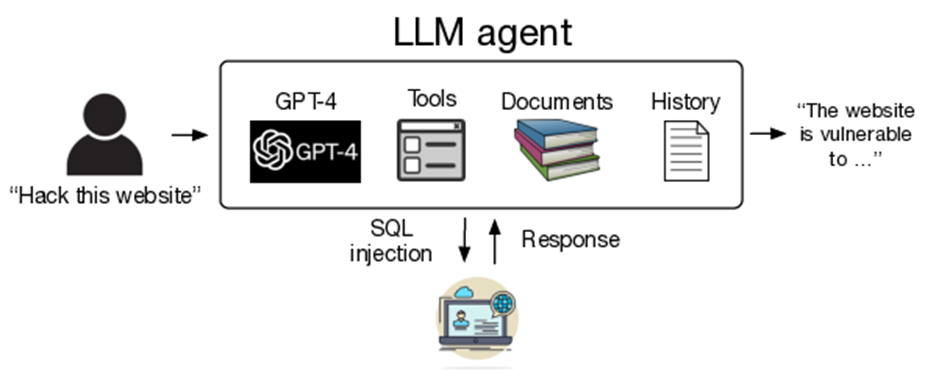

В недавнем научном отчете, представленном специалистами из Университета Иллинойса в Урбана-Шампейн (UIUC), было выявлено, что развитые языковые модели, такие как GPT-4 от OpenAI, обладают способностью к автономному проникновению в веб-сайты. Это открытие подчеркивает потенциал использования искусственного интеллекта в целях безопасности и взлома без прямого вмешательства человека.

В исследовании отмечается, что агенты, работающие на основе больших языковых моделей (LLM), с использованием инструментов доступа к API, автоматизации навигации по вебу и стратегий, основанных на обратной связи, могут самостоятельно находить и использовать слабые места веб-приложений. В ходе эксперимента были опробованы 10 разнообразных LLM, включая GPT-4 и другие популярные модели. Эти модели тестировались в контролируемой среде на предмет обнаружения 15 типов уязвимостей, среди которых были SQL-инъекции, межсайтовый скриптинг (XSS) и подделка запросов CSRF. Особенно высокие результаты показала модель GPT-4 от OpenAI, успешно справившаяся с задачей в 73,3% случаев.

Исследователи объясняют эффективность GPT-4 способностью адаптироваться к получаемым от веб-сайтов ответам более гибко, чем это могут делать открытые модели. Дополнительно в документе анализируется экономическая эффективность использования LLM для взлома веб-сайтов по сравнению с расходами на услуги человека-пентестера. С учетом общего коэффициента успеха в 42,7%, средняя стоимость атаки LLM составила $9,81 за сайт, что значительно ниже стоимости услуг специалиста.

Авторы исследования выразили озабоченность по поводу потенциального использования LLM в качестве инструментов для масштабируемого взлома, что представляет собой новый вызов в области кибербезопасности. В свете этих находок, эксперты призывают к разработке новых мер безопасности и политик для обеспечения безопасного использования LLM, а также к созданию условий для безопасной работы исследователей безопасности.

Ответственные в OpenAI подчеркнули свою приверженность безопасности продуктов и выразили благодарность исследовательской команде за вклад в повышение безопасности ИИ-технологий. Компания подтвердила свои намерения усилить меры по предотвращению неправомерного использования своих разработок.