Генеративный ИИ взял штурмом потребительский ландшафт в 2023 году, достигнув более 1 миллиарда долларов потребительских расходов за рекордно короткое время. Мы считаем, что в 2024 году возможности получения дохода на предприятии будут многократно больше.

В прошлом году, в то время как потребители часами общались с новыми партнерами по ИИ или делали изображения и видеоролики с использованием диффузионных моделей, взаимодействие предприятий с genAI, казалось, ограничивалось несколькими очевидными вариантами использования и поставкой продуктов в “GPT-оболочке” в виде новых артикулов. Некоторые скептики сомневались, что genAI вообще сможет масштабироваться на предприятии. Разве мы не застряли с теми же тремя вариантами использования? Могут ли эти стартапы на самом деле зарабатывать деньги? Разве все это не шумиха?

За последние пару месяцев мы поговорили с десятками представителей Fortune 500 и ведущих руководителей предприятий,2 и опросили еще 70 человек, чтобы понять, как они используют генеративный ИИ, покупают его и составляют бюджет. Мы были шокированы тем, насколько значительно изменились ресурсы и отношение к genAI за последние 6 месяцев. Хотя у этих лидеров все еще есть некоторые оговорки по поводу развертывания генеративного ИИ, они также почти утроили свои бюджеты, увеличили количество вариантов использования, которые развертываются на небольших моделях с открытым исходным кодом, и перенесли больше рабочих нагрузок с ранних экспериментов на производство.

Это огромная возможность для основателей. Мы считаем, что стартапы в области ИИ, которые 1) разрабатывают стратегические инициативы предприятий, ориентированные на ИИ, предвидя их болевые точки, и 2) переходят от подхода, ориентированного на услуги, к созданию масштабируемых продуктов, захватят эту новую волну инвестиций и займут значительную долю рынка.

Как всегда, создание и продажа любого продукта для предприятия требует глубокого понимания бюджетов, проблем и дорожных карт клиентов. Чтобы дать основателям представление о том, как руководители предприятий принимают решения о внедрении генеративного ИИ, и дать руководителям ИИ представление о том, как другие лидеры в этой области решают те же проблемы, что и они, мы изложили 16 важнейших соображений о ресурсах, моделях и вариантах использования из наших недавних бесед с этими лидерами ниже.

Финансирование ресурсами: бюджеты резко растут и надолго

1. Бюджеты на генеративный ИИ стремительно растут.

В 2023 году средние затраты на API базовой модели, автономный хостинг и тонкую настройку моделей составили 7 миллионов долларов в десятках компаний, с которыми мы общались. Более того, почти каждое предприятие, с которым мы разговаривали, увидело многообещающие ранние результаты экспериментов genAI и запланировало увеличить свои расходы где-то с 2 до 5 раз в 2024 году, чтобы поддержать внедрение большего количества рабочих нагрузок в производство.

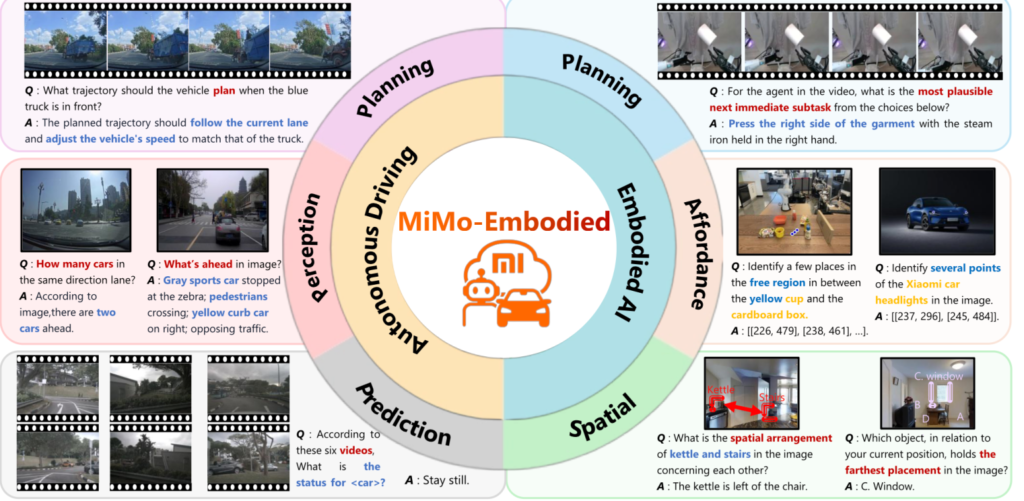

2. Лидеры начинают перераспределять инвестиции в ИИ по текущим статьям бюджета на программное обеспечение.

Неудивительно, что в прошлом году большая часть расходов enterprise genAI была произведена за счет ”инновационных» бюджетов и других, как правило, единовременных фондов финансирования. Однако в 2024 году многие руководители перераспределяют эти расходы на более постоянные линейки программного обеспечения; менее четверти сообщили, что расходы genAI в этом году будут поступать из бюджетов на инновации. В гораздо меньших масштабах мы также начали видеть, как некоторые лидеры используют свой бюджет genAI для экономии численности персонала, особенно в сфере обслуживания клиентов. Мы рассматриваем это как предвестие значительно более высоких будущих расходов на genAI, если тенденция сохранится. Одна компания назвала экономию ~ 6 долларов за каждый звонок, обслуживаемый их службой поддержки клиентов на базе LLM, что в общей сложности составляет ~ 90% экономии затрат, в качестве причины восьмикратного увеличения своих инвестиций в genAI.

Вот общая разбивка того, как организации распределяют свои расходы на получение степени магистра права:

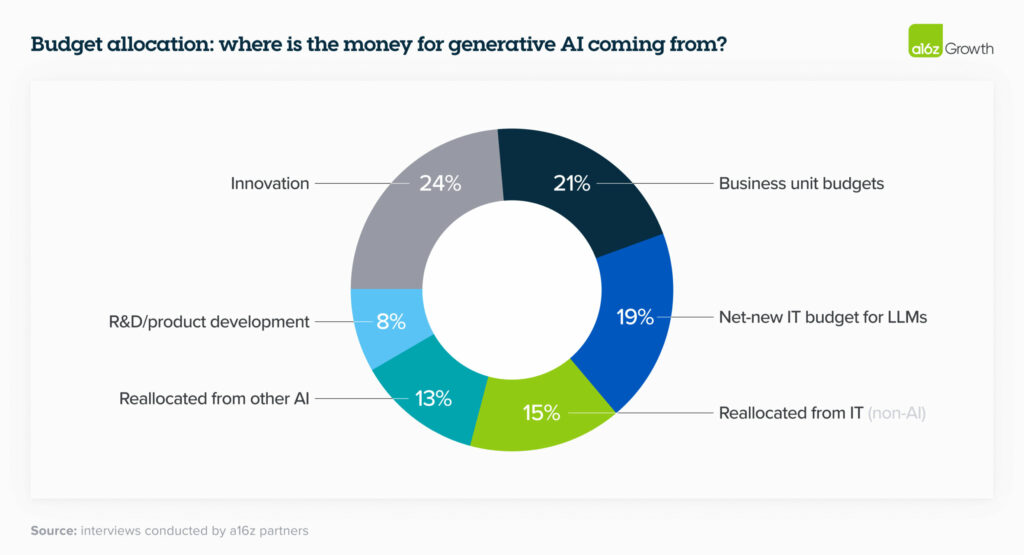

3. Измерение рентабельности инвестиций по-прежнему остается искусством и наукой.

Руководители предприятий в настоящее время в основном измеряют рентабельность инвестиций по увеличению производительности, обеспечиваемой ИИ. Хотя они полагаются на NPS и удовлетворенность клиентов в качестве хороших косвенных показателей, они также ищут более ощутимые способы измерения отдачи, такие как получение дохода, экономия, повышение эффективности и точности, в зависимости от их варианта использования. В ближайшей перспективе лидеры все еще внедряют эту технологию и определяют наилучшие показатели для количественной оценки прибыли, но в течение следующих 2-3 лет рентабельность инвестиций будет приобретать все большее значение. Пока руководители пытаются найти ответ на этот вопрос, многие принимают это на веру, когда их сотрудники говорят, что они лучше используют свое время.

4. Внедрение и масштабирование генеративного ИИ требует соответствующих технических навыков, которых в настоящее время нет у многих предприятий.

Простого наличия API у поставщика моделей недостаточно для создания и масштабного развертывания генеративных ИИ-решений. Для внедрения, обслуживания и масштабирования необходимой вычислительной инфраструктуры требуются высококвалифицированные специалисты. Одно только внедрение составило одну из крупнейших областей расходов на ИИ в 2023 году, а в некоторых случаях и самую крупную. Один из руководителей упомянул, что “на LLM, вероятно, приходится четверть затрат на создание вариантов использования”, при этом затраты на разработку составляют большую часть бюджета.

Чтобы помочь предприятиям внедрить и запустить свои модели, поставщики базовых моделей предлагали и продолжают предоставлять профессиональные услуги, обычно связанные с разработкой пользовательских моделей. По нашим оценкам, это обеспечило этим компаниям значительную часть выручки в 2023 году и, в дополнение к производительности, является одной из ключевых причин, по которым предприятия выбирали определенных поставщиков моделей. Поскольку на предприятии очень сложно привлечь нужных специалистов genAI, стартапы, предлагающие инструменты, облегчающие внедрение разработки genAI собственными силами, скорее всего, получат более быстрое внедрение.

Модели: предприятия стремятся к многомодельному миру с открытым исходным кодом

5. Многомодельное будущее.

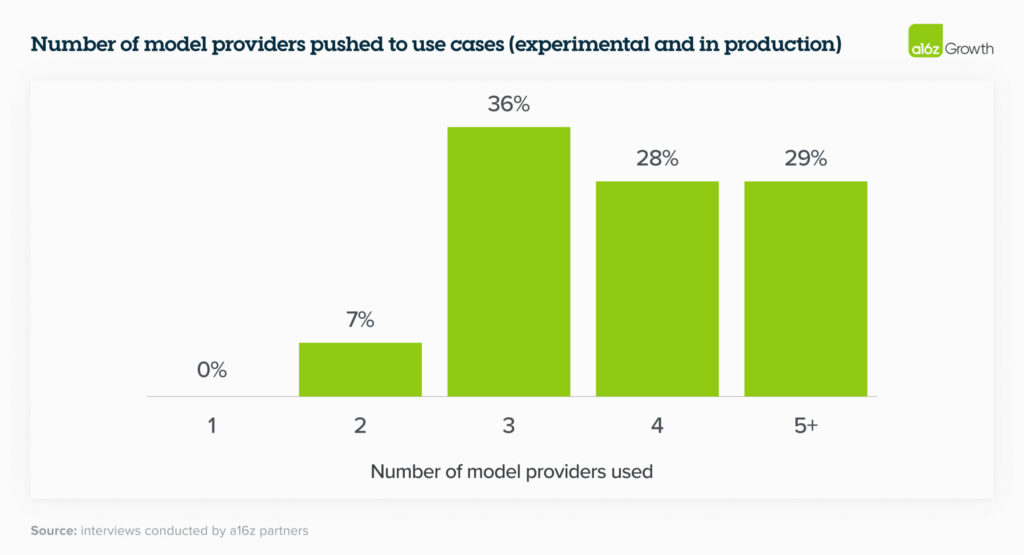

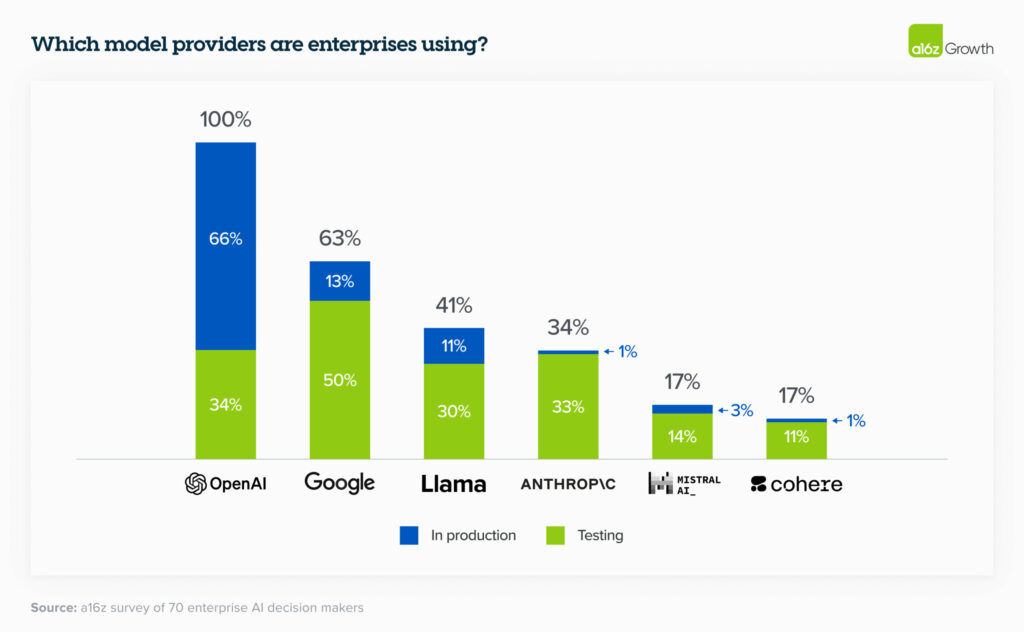

Чуть более 6 месяцев назад подавляющее большинство предприятий экспериментировали с 1 моделью (обычно OpenAI) или максимум с 2. Когда мы разговаривали сегодня с руководителями предприятий, все они тестируют — а в некоторых случаях даже используют в производстве—несколько моделей, что позволяет им 1) адаптировать варианты использования в зависимости от производительности, размера и стоимости, 2) избежать локализации и 3) быстро использовать достижения в быстро развивающейся области. Этот третий момент был особенно важен для руководителей, поскольку таблица лидеров моделей динамична, и компании рады использовать как текущие современные модели, так и модели с открытым исходным кодом для получения наилучших результатов.

Вероятно, мы увидим распространение еще большего числа моделей. В таблице ниже, составленной на основе данных опроса, руководители предприятий сообщили о тестировании ряда моделей, что является опережающим показателем моделей, которые будут использоваться для доведения рабочих нагрузок до производства. Что касается вариантов производственного использования, OpenAI по-прежнему занимает доминирующую долю рынка, как и ожидалось.

6. Открытый исходный код переживает бум.

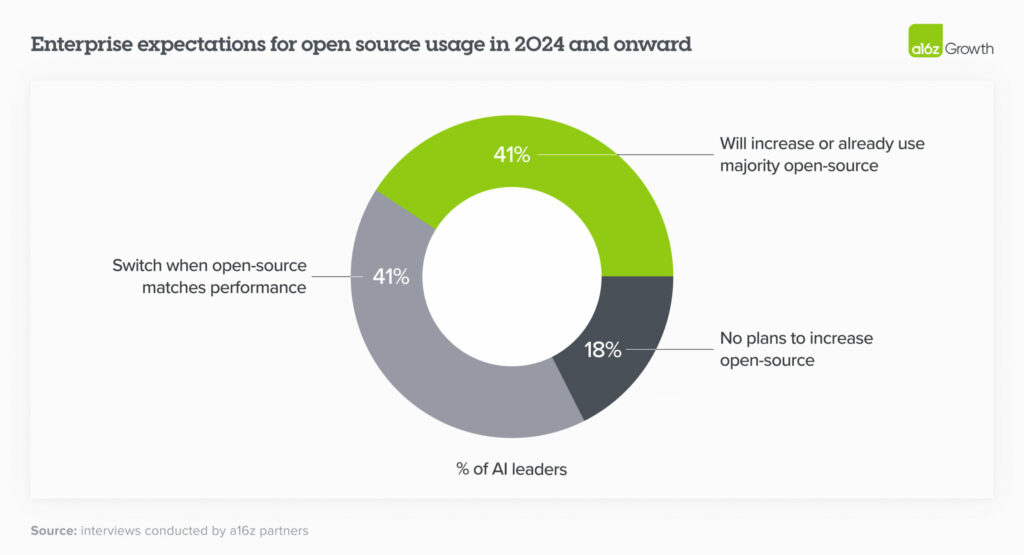

Это одно из самых удивительных изменений в мире за последние 6 месяцев. По нашим оценкам, доля рынка в 2023 году составляла 80-90% с закрытым исходным кодом, причем большая часть доли принадлежала OpenAI. Однако 46% респондентов опроса отметили, что они предпочитают модели с открытым исходным кодом, которые появятся в 2024 году. В интервью почти 60% руководителей ИИ отметили, что они заинтересованы в расширении использования открытого исходного кода или переходе на другой, когда отлаженные модели с открытым исходным кодом примерно соответствуют производительности моделей с закрытым исходным кодом. Таким образом, в 2024 году и далее предприятия ожидают значительного смещения использования в сторону открытого исходного кода, причем некоторые из них явно нацелены на разделение 50/50 по сравнению с 80% закрытых / 20% открытых в 2023 году.

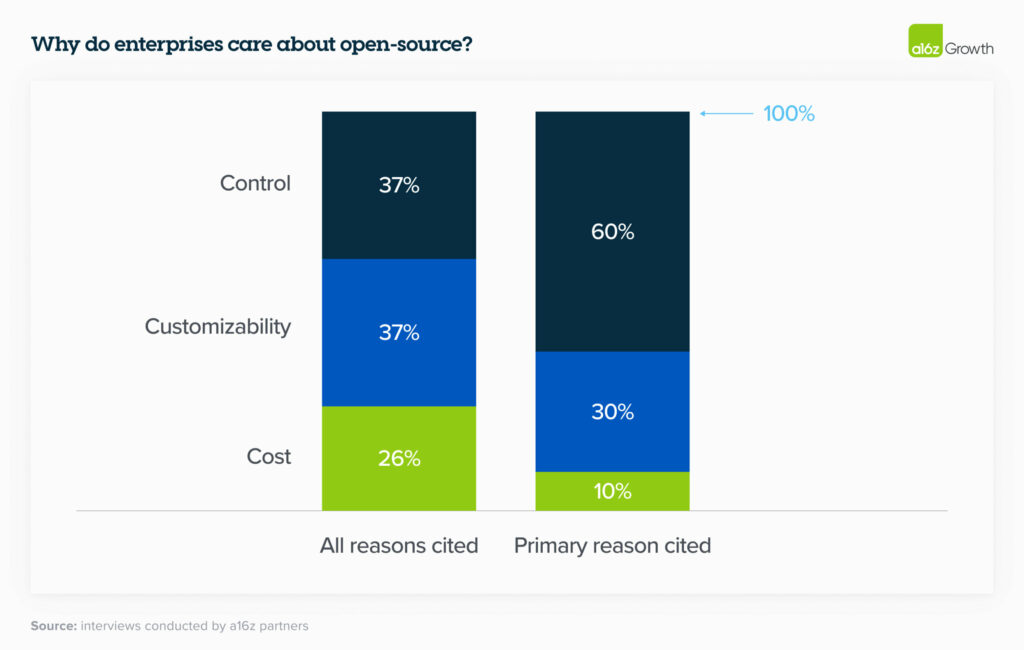

7. Хотя привлекательность открытого исходного кода была обусловлена стоимостью, он оказался ниже контроля и кастомизации в качестве ключевых критериев отбора.

Контроль (безопасность проприетарных данных и понимание того, почему модели дают определенные результаты) и кастомизация (возможность эффективной точной настройки для данного варианта использования) намного перевешивают затраты в качестве основных причин перехода на открытый исходный код. Мы были удивлены, что стоимость не была превыше всего, но это отражает нынешнюю убежденность руководства в том, что избыточная ценность, создаваемая генеративным ИИ, вероятно, намного перевесит его цену. Как объяснил один руководитель: “получение точного ответа стоит денег”.

8. Стремление к контролю проистекает из чувствительных вариантов использования и соображений безопасности корпоративных данных.

Предприятиям по-прежнему неудобно делиться своими конфиденциальными данными с поставщиками моделей с закрытым исходным кодом из соображений регулирования или безопасности данных — и неудивительно, что компании, чья интеллектуальная собственность занимает центральное место в их бизнес-модели, особенно консервативны. В то время как некоторые руководители решили эту проблему, самостоятельно разместив модели с открытым исходным кодом, другие отметили, что отдают предпочтение моделям с интеграцией в виртуальное частное облако (VPC).

9. Руководители обычно настраивают модели путем тонкой настройки, а не создают их с нуля.

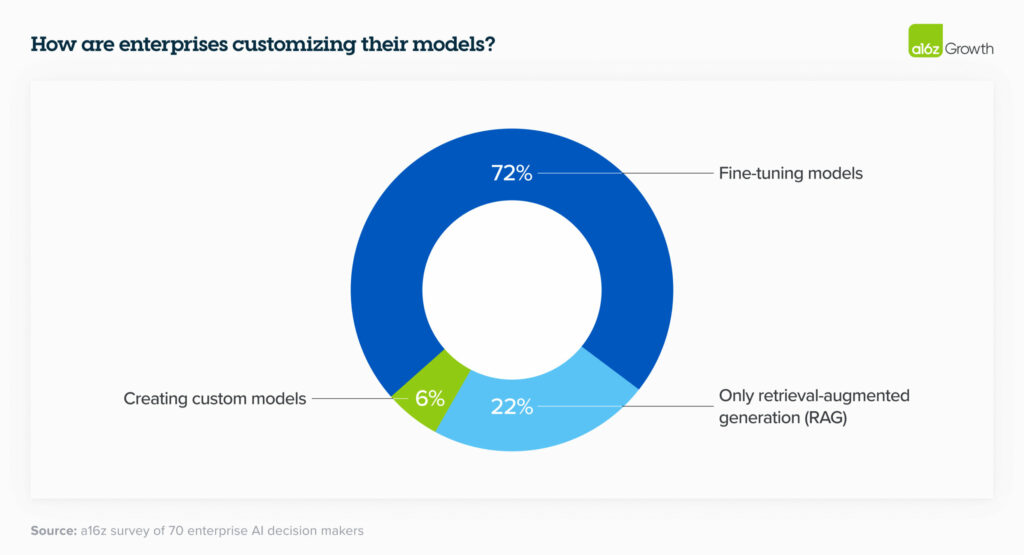

В 2023 году было много дискуссий о создании пользовательских моделей, таких как BloombergGPT. В 2024 году предприятия по-прежнему заинтересованы в кастомизации моделей, но с появлением высококачественных моделей с открытым исходным кодом большинство предпочитают не обучать своих собственных LLM с нуля, а вместо этого использовать генерацию с расширенным поиском (RAG) или точно настроить модель с открытым исходным кодом для своих конкретных нужд.

10. Облако по-прежнему оказывает большое влияние на решения о покупке моделей.

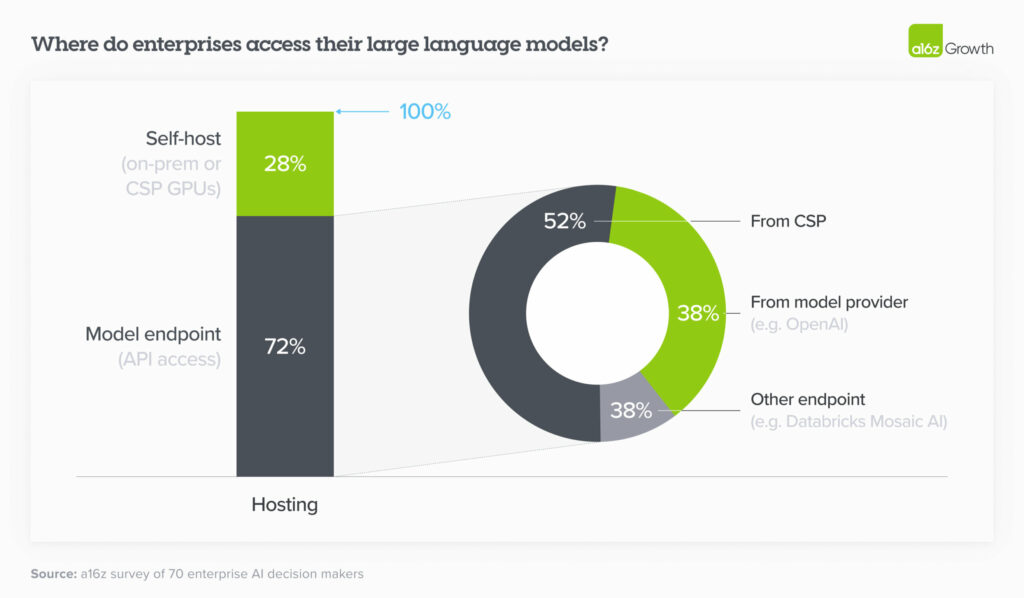

В 2023 году многие предприятия закупали модели через своего существующего поставщика облачных услуг (CSP) по соображениям безопасности — руководители были больше обеспокоены тем, что модели с закрытым исходным кодом неправильно обрабатывают их данные, чем их CSP, — и чтобы избежать длительных процессов закупок. Это все еще имеет место в 2024 году, что означает, что корреляция между CSP и предпочтительной моделью довольно высока: пользователи Azure в целом предпочитали OpenAI, в то время как пользователи Amazon предпочитали Anthropic или Cohere. Как мы можем видеть на диаграмме ниже, из 72% предприятий, использующих API для доступа к своей модели, более половины использовали модель, размещенную в их CSP. (Обратите внимание, что более четверти респондентов самостоятельно разместили свои приложения, вероятно, для того, чтобы запускать модели с открытым исходным кодом.)

11. Клиенты по-прежнему интересуются функциями, которые рано выводятся на рынок.

В то время как руководители называли способность к аргументации, надежность и простоту доступа (например, к их CSP) в качестве основных причин для принятия данной модели, лидеры также тяготели к моделям с другими дифференцированными характеристиками. Многие руководители ссылались на предыдущее контекстное окно в 200 Тыс. как на ключевую причину внедрения Anthropic, в то время как другие выбрали Cohere из-за их раннего выхода на рынок и простого в использовании предложения по тонкой настройке.

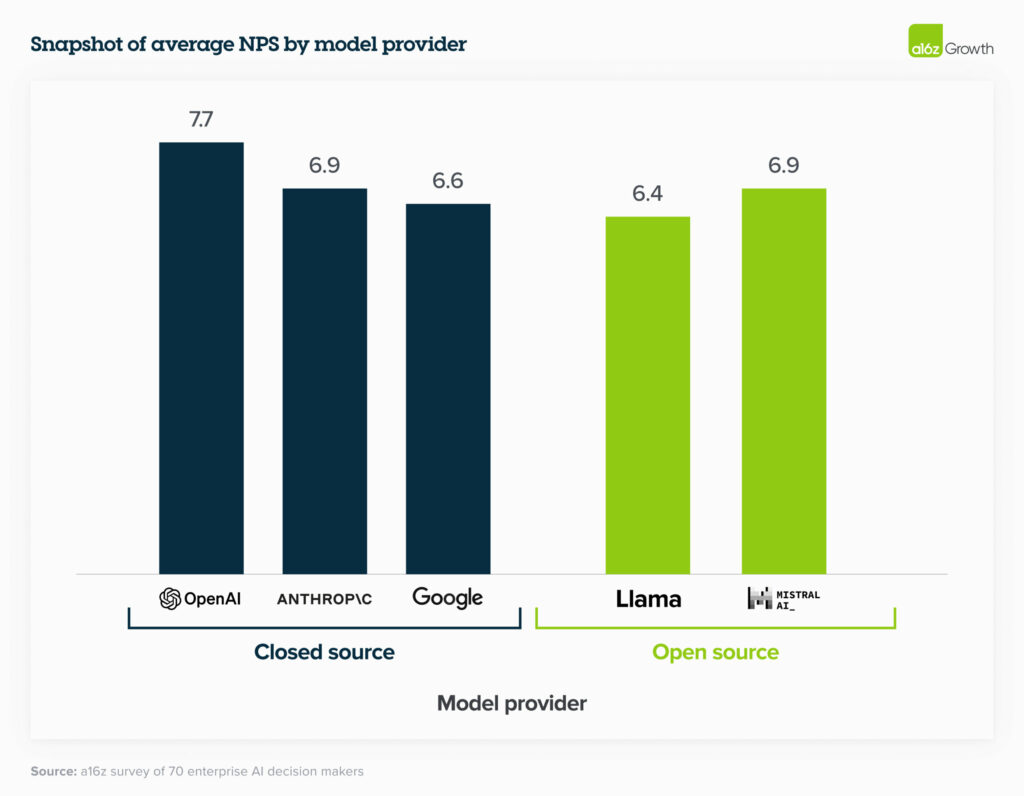

12. Тем не менее, большинство предприятий считают, что эффективность моделей сходится.

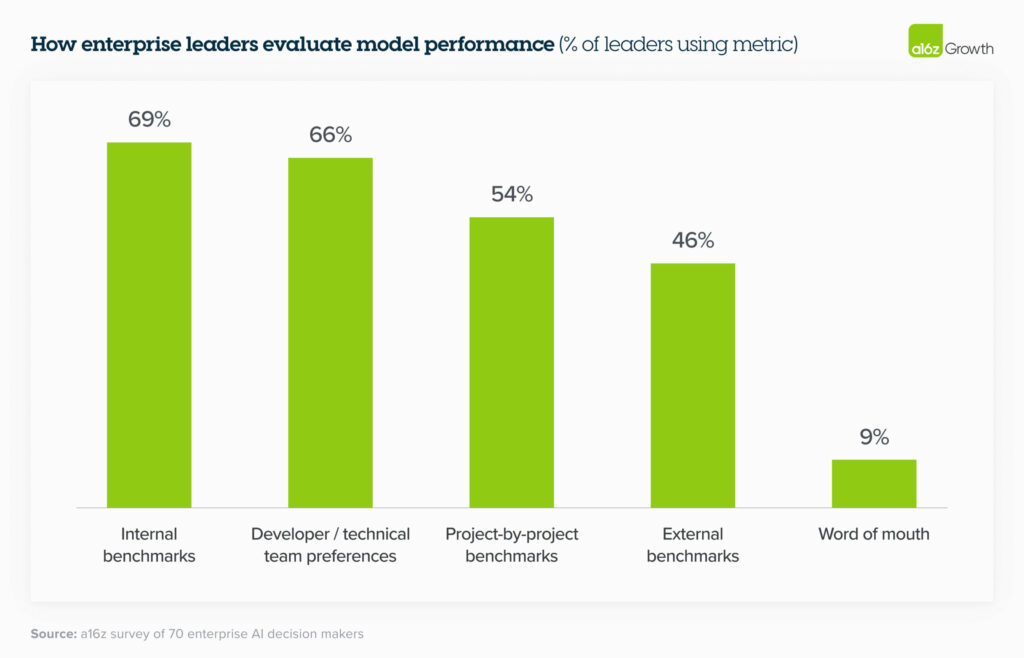

В то время как большая часть технологического сообщества сосредоточена на сравнении производительности моделей с общедоступными эталонами, руководители предприятий больше сосредоточены на сравнении производительности отлаженных моделей с открытым исходным кодом и отлаженных моделей с закрытым исходным кодом с их собственными внутренними наборами эталонов. Интересно, что, несмотря на то, что модели с закрытым исходным кодом обычно показывают лучшие результаты во внешних контрольных тестах, руководители предприятий по-прежнему оценивали модели с открытым исходным кодом относительно высоко (а в некоторых случаях и выше), потому что их легче настроить под конкретные варианты использования. Одна компания обнаружила, что “после тонкой настройки Mistral и Llama работают почти так же хорошо, как OpenAI, но при гораздо более низких затратах”. По этим стандартам производительность моделей повышается даже быстрее, чем мы ожидали, что дает руководителям более широкий выбор очень мощных моделей на выбор.

13. Оптимизация для повышения эффективности.

Большинство предприятий разрабатывают свои приложения таким образом, что для переключения между моделями требуется всего лишь изменение API. Некоторые компании даже проводят предварительное тестирование подсказок, так что изменения происходят буквально по щелчку переключателя, в то время как другие создали “сады моделей”, из которых они могут развертывать модели в различных приложениях по мере необходимости. Компании используют этот подход отчасти потому, что они извлекли из облачной эры несколько тяжелых уроков о необходимости снижения зависимости от поставщиков, а отчасти потому, что рынок развивается такими быстрыми темпами, что кажется неразумным связывать себя обязательствами с одним поставщиком.

Примеры использования: больше переходов на производство

14. Предприятия создают, а не покупают приложения — пока.

Предприятия в подавляющем большинстве своем сосредоточены на создании собственных приложений, ссылаясь на отсутствие проверенных в боях корпоративных приложений искусственного интеллекта в качестве одной из причин. В конце концов, для подобных приложений не существует волшебных секторов (пока!). Модели foundation также как никогда упростили для предприятий создание собственных приложений с ИИ, предлагая API. Предприятия теперь создают свои собственные версии знакомых вариантов использования, таких как служба поддержки клиентов и внутренние чат—боты, а также экспериментируют с более новыми вариантами использования, такими как написание рецептов CPG, сужение области поиска молекул и выработка рекомендаций по продажам. Много было написано об ограниченной дифференциации «GPT-оболочек» или стартапов, создающих знакомый интерфейс (например, чат-бота) для хорошо известного результата LLM (например, обобщения документов); одна из причин, по которой мы считаем, что у них будут проблемы, заключается в том, что ИИ еще больше снизил барьер для создания аналогичных приложений собственными силами.

Однако пока неясно, изменится ли ситуация, когда на рынок выйдет больше приложений с ИИ, ориентированных на предприятия. Один из руководителей отметил, что, хотя они разрабатывают множество вариантов использования собственными силами, они оптимистичны, что “появятся новые инструменты», и предпочли бы “использовать лучшее, что есть”. Другие считают, что genAI становится все более «стратегическим инструментом”, который позволяет компаниям внедрять определенные функциональные возможности собственными силами вместо того, чтобы полагаться, как они традиционно делали, на внешних поставщиков. Учитывая эту динамику, мы считаем, что приложения, которые выходят за рамки формулы “LLM + UI” и существенно переосмысливают базовые рабочие процессы предприятий или помогают предприятиям лучше использовать свои собственные данные, будут особенно эффективны на этом рынке.

15. Предприятия в восторге от внутренних вариантов использования, но проявляют большую осторожность в отношении внешних.

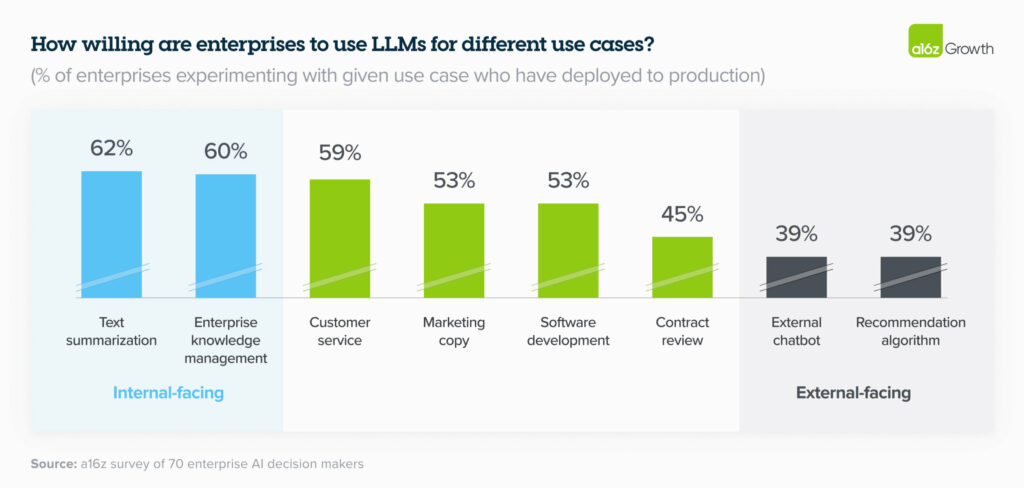

Это связано с тем, что на предприятии по-прежнему существуют две основные проблемы, связанные с genAI: 1) потенциальные проблемы с галлюцинациями и безопасностью, и 2) проблемы с связями с общественностью при внедрении genAI, особенно в чувствительных секторах потребителей (например, в здравоохранении и финансовых услугах). Самые популярные варианты использования прошлого года были либо сосредоточены на внутренней производительности, либо передавались через человека, прежде чем попасть к клиенту, — например, вторые пилоты по программированию, служба поддержки клиентов и маркетинг. Как мы можем видеть на диаграмме ниже, эти варианты использования по-прежнему доминируют на предприятиях в 2024 году, когда предприятия внедряют полностью внутренние варианты использования, такие как обобщение текста и управление знаниями (например, внутренний чат-бот), в производство гораздо быстрее, чем чувствительные варианты использования с участием человека в цикле, такие как проверка контрактов, или варианты использования с учетом потребностей клиентов, такие как внешние чат-боты или алгоритмы рекомендаций. Компании стремятся избежать последствий неудач с генеративным ИИ, таких как сбой в обслуживании клиентов Air Canada. Поскольку эти проблемы по-прежнему актуальны для большинства предприятий, стартапы, создающие инструменты, которые могут помочь контролировать эти проблемы, могут получить широкое распространение.

Размер общих возможностей: масштабный и быстро растущий

16. Мы считаем, что общие расходы на модельные API и тонкую настройку вырастут до более чем 5 миллиардов долларов к концу 2024 года, и расходы предприятий составят значительную часть этой возможности.

По нашим расчетам, рынок model API (включая тонкую настройку) завершил 2023 год с доходом в размере 1,5-2 млрд долларов, включая расходы на модели OpenAI через Azure. Учитывая ожидаемый рост рынка в целом и конкретные указания предприятий, расходы только на эту область вырастут к концу года как минимум до 5 млрд долларов в годовом исчислении со значительным потенциалом роста. Как мы уже обсуждали, предприятия уделили приоритетное внимание развертыванию genAI, увеличили бюджеты и перераспределили их на стандартные линейки программного обеспечения, оптимизировали варианты использования в различных моделях и планируют увеличить нагрузку на производство в 2024 году, что означает, что они, вероятно, обеспечат значительную часть этого роста.

За последние 6 месяцев предприятия получили нисходящий мандат на поиск и внедрение решений genAI. Сделки, на заключение которых раньше уходило больше года, теперь заключаются за 2-3 месяца, и эти сделки намного крупнее, чем были в прошлом. Хотя в этом посте основное внимание уделяется уровню базовой модели, мы также считаем, что эта возможность на предприятии распространяется и на другие части стека — от инструментов, помогающих в тонкой настройке, до обслуживания моделей, создания приложений и специализированных нативных приложений с ИИ. Мы находимся на переломном этапе в развитии genAI на предприятии, и мы рады сотрудничать со следующим поколением компаний, обслуживающих этот динамичный и растущий рынок.